AI и GPU-вычисления

Инфраструктура для обучения моделей,

HPC-кластеров и GPU-ускоренных задач.

Сценарии использования

Обучение моделей машинного обучения

Инфраструктура для обучения нейронных сетей, LLM-моделей и задач компьютерного зрения.

Высокопроизводительные вычисления (HPC)

Научные расчёты, моделирование, инженерные и исследовательские задачи.

AI-сервисы и inference

Развертывание моделей искусственного интеллекта для обработки пользовательских запросов и аналитики.

Аналитика и обработка больших данных

Ускорение обработки больших массивов данных и сложных аналитических задач.

Для кого

НИИ и лаборатории

Инфраструктура для научных вычислений, моделирования и анализа данных.

Технологические компании

Разработка AI-продуктов, сервисов машинного обучения и аналитических платформ.

AI-аналитические платформы

Использование AI для обработки данных, прогнозирования и бизнес-аналитики.

Медицинские организации

Анализ медицинских изображений, геномные исследования и биоинформатика.

Входные параметры

- Тип нагрузки

Обучение моделей, inference, аналитика или смешанный сценарий.

- Масштаб GPU-кластера

Планируемое количество GPU на старте и ожидаемый рост.

- Тип и объём данных

Общий объём датасетов, формат данных и интенсивность работы с ними.

- Требования к производительности

Желаемое время обучения моделей или скорость обработки запросов.

- Сетевая архитектура

Требуемая пропускная способность, задержки и тип сети (Ethernet / InfiniBand).

- Требования к хранению данных

Тип хранилища (NVMe, SSD, объектное), объём и скорость доступа.

- Требования к отказоустойчивости

Допустимые простои, резервирование узлов и компонентов.

- План масштабирования

Планируемое расширение инфраструктуры в течение 1–3 лет.

- Ограничения площадки

Доступная мощность питания, охлаждение и физическое размещение оборудования.

- Интеграция с существующей инфраструктурой

Текущие серверы, системы хранения, сеть и программные платформы.

Архитектура решения

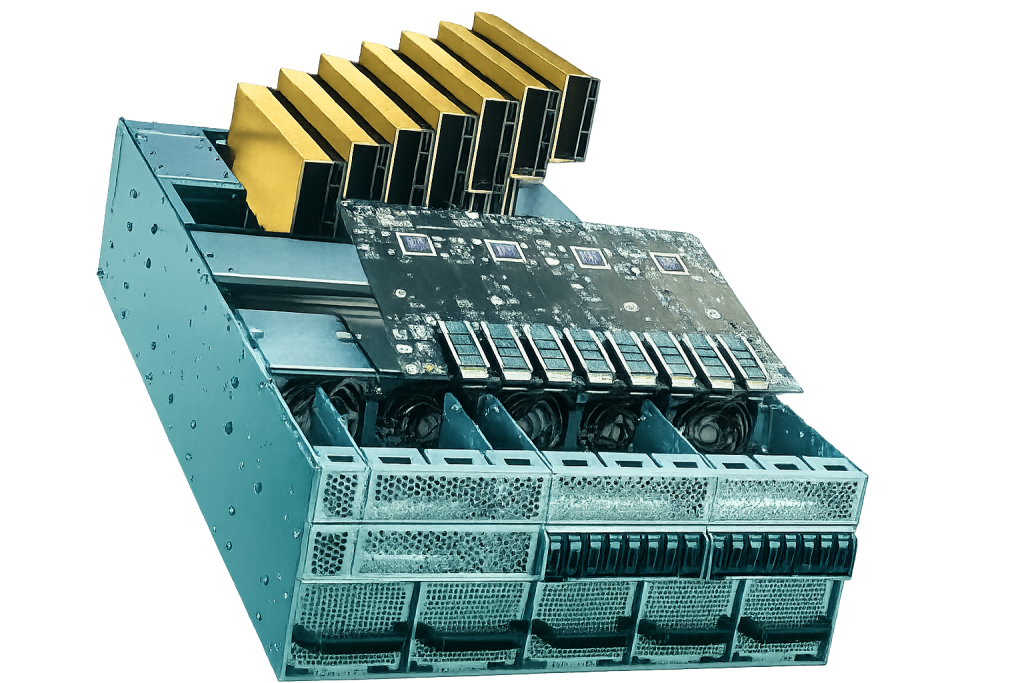

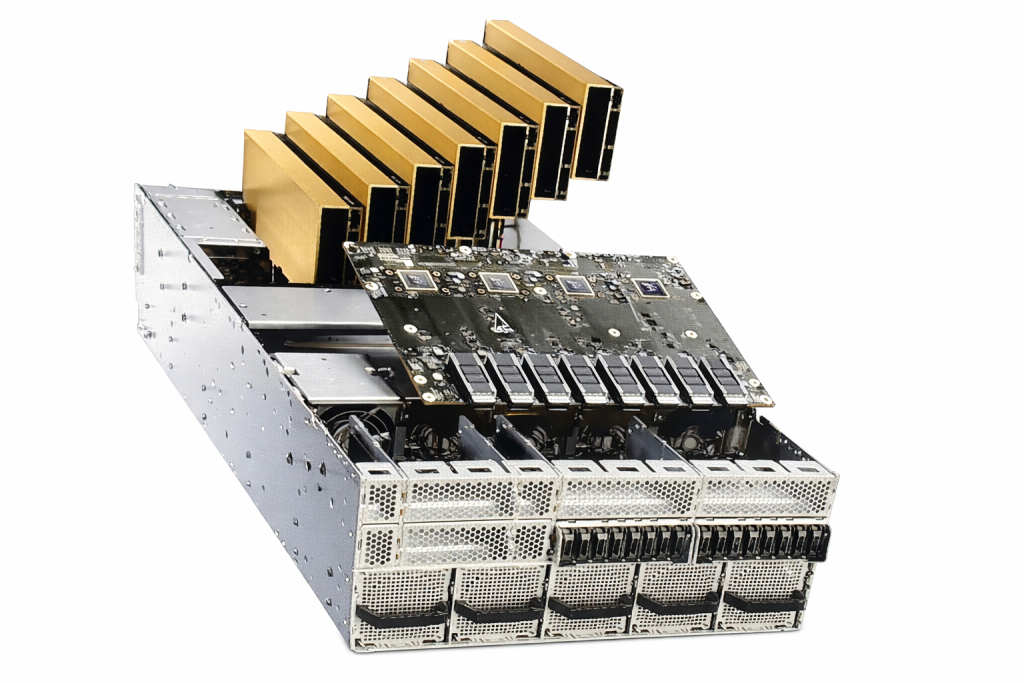

Вычислительный слой

GPU-узлы обеспечивают основную вычислительную мощность для обучения моделей, inference и высокопроизводительных вычислений.

Типовые параметры: 4–8 GPU на узел • high-memory platforms • PCIe / NVLink

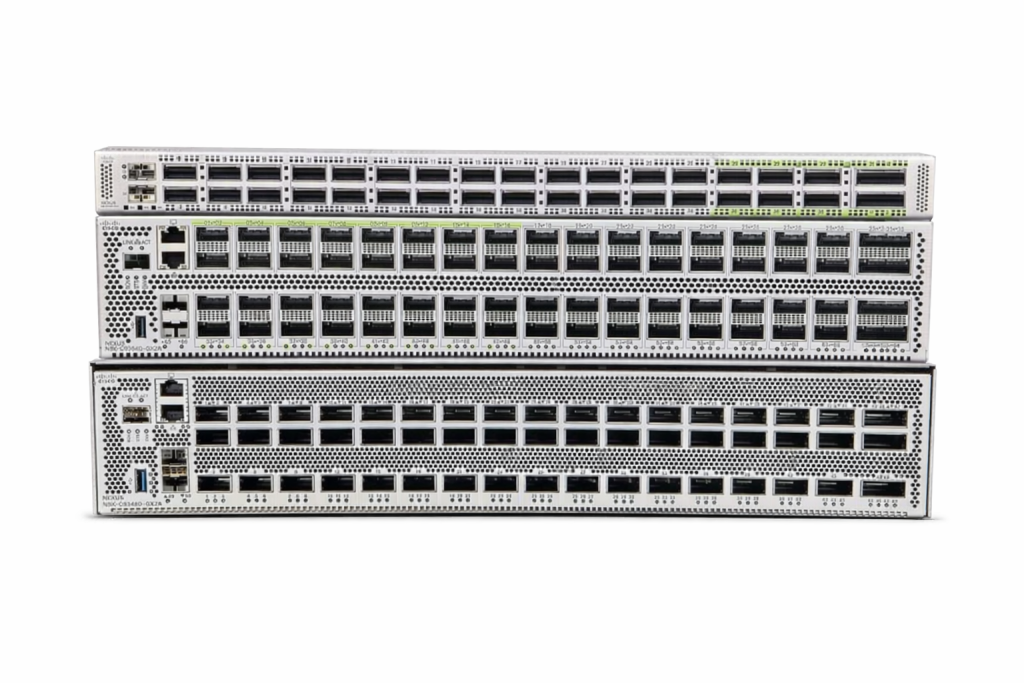

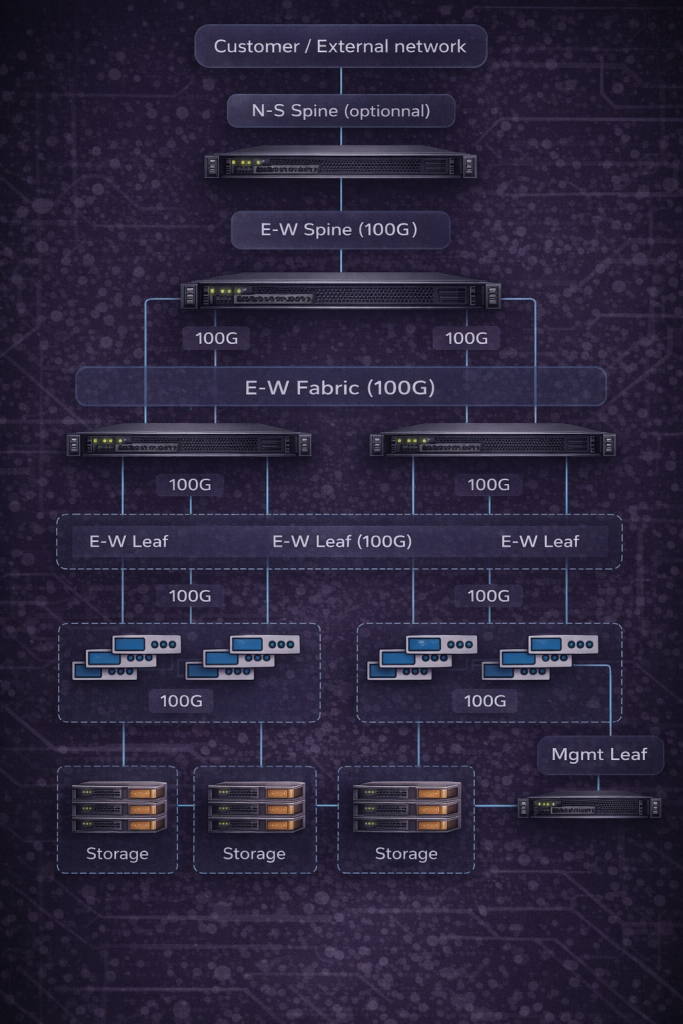

Сетевой слой

Высокоскоростная сеть объединяет вычислительные узлы в единый кластер и обеспечивает быстрый обмен данными между серверами и системами хранения.

Типовые параметры: 100 / 200 / 400G • low latency • масштабируемая fabric-архитектура

Слой хранения данных

Системы хранения используются для размещения датасетов, моделей и результатов вычислений и обеспечивают необходимую скорость доступа к данным.

Типовые параметры: NVMe / SSD • высокий IOPS • масштабируемый объём и throughput

Диагностика и мониторинг

Для стабильной работы GPU-кластеров необходимо контролировать состояние сетевой инфраструктуры, пропускную способность fabric-сети и качество высокоскоростных оптических соединений.

Диагностика позволяет выявлять узкие места, ошибки передачи данных и деградацию каналов до того, как они начнут влиять на обучение моделей и распределённые вычисления.

В таких системах обычно контролируют три вещи:

Контроль сетевых потоков

- анализ сетевых потоков

- зеркалирование трафика

- aggregation / filtering потоков

Gigamon

Тестирование fabric-сети

Примеры конфигурации AI-инфраструктуры

Ниже приведены типовые конфигурации GPU-кластеров для задач машинного обучения. Выберите уровень инфраструктуры, чтобы увидеть пример архитектуры и используемого оборудования.

Research / Entry AI cluster

(малые команды, R&D, пилоты)

Сетевой уровень (Core / Aggregation)

Cisco Nexus 93180YC-FX

Arista 7050X3

NVIDIA Spectrum SN3700

Коммутаторы доступа (ToR)

Cisco Nexus 9336C-FX2

Arista 7060CX2

NVIDIA SN2700

GPU узлы

Supermicro AS-4124GS-TNR

ASUS ESC8000A-E12

Gigabyte G492-ZD2

GPU:

NVIDIA L40S

NVIDIA RTX 6000 Ada

NVIDIA A100 PCIe

Система хранения данных

Dell PowerVault ME5024

HPE MSA 2060

Сеть управления (Management)

Cisco Catalyst 1000

Huawei S5735

Пилотная AI-инфраструктура

Быстрый запуск AI-проектов без сложной инфраструктуры

Поддержка 1–2 GPU серверов (до 8 GPU)

Высокоскоростная сеть 100G Ethernet

Отказоустойчивая архитектура (dual ToR, MLAG / vPC)

Разделение data и management сети

Масштабирование до production-кластера